Những thách thức trong việc đặt đầu ảo để phát triển AR

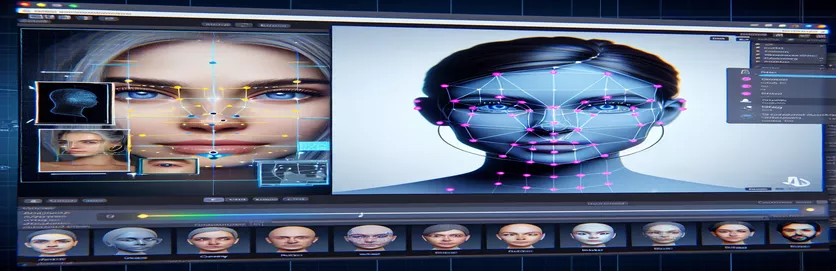

Làm việc trên một dự án thực tế tăng cường (AR) có thể vừa thú vị vừa đầy thử thách. Khi phát triển một ứng dụng Android với Unity, tôi mong muốn kết hợp liền mạch thế giới kỹ thuật số và thế giới thực bằng cách đặt một cái đầu ảo lên các khuôn mặt trong thế giới thực. Tính năng này phụ thuộc rất nhiều vào độ chính xác để tạo ra trải nghiệm sống động. 🕶️

Để đạt được điều này, tôi đã sử dụng MediaPipe của Google để phát hiện các đặc điểm trên khuôn mặt như mắt, mũi và miệng. Sau đó, đầu ảo được tạo và đặt dựa trên những điểm chính này. Thật thú vị khi thấy các công cụ hiện đại có thể biến đổi khả năng AR như thế nào, nhưng hành trình này còn lâu mới hoàn hảo.

Vấn đề nảy sinh khi đầu ảo không khớp với khuôn mặt thật như mong đợi. Bất kể góc độ hay thiết bị nào, vị trí luôn hơi "lệch", dẫn đến hiệu ứng không tự nhiên. Như thể sự thể hiện ảo đã bị ngắt kết nối với thực tế. Điều này đã gây ra một loạt các thử nghiệm khắc phục sự cố.

Từ việc điều chỉnh cài đặt camera của Unity đến thử nghiệm thuật toán của MediaPipe, mọi nỗ lực đều mang lại những cải tiến gia tăng nhưng không có giải pháp dứt điểm. Bài viết này đi sâu vào cốt lõi của vấn đề, bài học kinh nghiệm và giải pháp tiềm năng cho các nhà phát triển đang gặp phải những thách thức tương tự. 🚀

| Yêu cầu | Ví dụ về sử dụng |

|---|---|

| mainCamera.usePhysicalProperties | Lệnh này cho phép sử dụng các thuộc tính máy ảnh vật lý của Unity, cho phép kiểm soát chính xác hơn độ dài tiêu cự và độ biến dạng của ống kính để căn chỉnh các vật thể ảo và thế giới thực. |

| faceMesh.GetDetectedFaceTransform() | Truy xuất dữ liệu biến đổi (vị trí và góc quay) của khuôn mặt được phát hiện từ lưới mặt của MediaPipe, điều này rất quan trọng để đặt chính xác các đầu ảo trên các mặt thật. |

| UnityObjectToClipPos | Một chức năng dành riêng cho trình đổ bóng giúp chuyển đổi vị trí đỉnh từ không gian đối tượng sang không gian clip, được sử dụng trong các trình đổ bóng hiệu chỉnh méo ống kính để đảm bảo căn chỉnh. |

| tex2D | Lệnh đổ bóng được sử dụng để lấy mẫu kết cấu ở tọa độ UV được chỉ định, cần thiết để áp dụng hiệu chỉnh biến dạng cho nguồn cấp dữ liệu máy ảnh. |

| length(distUV) | Tính toán khoảng cách Euclide của tọa độ UV từ gốc, được tận dụng để áp dụng các điều chỉnh độ méo ống kính dần dần. |

| adjuster.virtualHead | Một biến tập lệnh đề cập đến đầu ảo GameObject, cho phép vị trí và góc xoay của nó được cập nhật động dựa trên dữ liệu theo dõi khuôn mặt. |

| [TestFixture] | Thuộc tính NUnit đánh dấu một lớp là đối tượng kiểm tra, báo hiệu rằng lớp đó chứa các bài kiểm tra đơn vị. Điều này rất hữu ích để xác minh logic căn chỉnh đầu ảo. |

| Assert.AreEqual | Phương pháp NUnit được sử dụng để so sánh giá trị mong đợi và thực tế trong quá trình thử nghiệm đơn vị, đảm bảo vị trí đầu ảo phù hợp với kết quả mong muốn. |

| _DistortionStrength | Thuộc tính đổ bóng giúp điều chỉnh cường độ biến dạng của ống kính, tinh chỉnh sự liên kết giữa thế giới thực và ảo. |

| Quaternion.Euler | Tạo một vòng xoay dựa trên các góc Euler, thường được sử dụng để căn chỉnh các đối tượng như đầu ảo trong không gian 3D của Unity. |

Nâng cao độ chính xác AR với Unity và MediaPipe

Tập lệnh đầu tiên chúng tôi khám phá tập trung vào việc sử dụng các thuộc tính máy ảnh vật lý của Unity. Bằng cách kích hoạt sử dụngThuộc tính vật lý, chúng tôi điều chỉnh hoạt động của máy ảnh để phù hợp hơn với quang học trong thế giới thực. Điều này đặc biệt quan trọng khi làm việc với AR, trong đó ngay cả những khác biệt nhỏ về tiêu cự hoặc trường nhìn cũng có thể khiến các vật thể ảo có vẻ bị lệch. Ví dụ: đặt tiêu cự thành giá trị chính xác như 35mm có thể giúp căn chỉnh đầu ảo với khuôn mặt được phát hiện. Việc điều chỉnh này giống như tinh chỉnh kính viễn vọng để đưa các vật thể ở xa vào tiêu điểm hoàn hảo, đảm bảo trải nghiệm AR mang lại cảm giác tự nhiên và sống động. 📸

Một thành phần quan trọng khác của tập lệnh là truy xuất vị trí và góc xoay của khuôn mặt được phát hiện bằng cách sử dụng faceMesh.GetDetectedFaceTransform(). Chức năng này cung cấp các cập nhật theo thời gian thực từ lưới mặt của MediaPipe, điều này rất cần thiết để đồng bộ hóa đầu ảo với chuyển động của người dùng. Hãy tưởng tượng bạn đang chơi một trò chơi điện tử trong đó đầu của nhân vật không di chuyển đồng bộ với đầu của bạn; trải nghiệm sẽ rất chói tai. Bằng cách đảm bảo căn chỉnh chính xác, tập lệnh này biến AR từ một công cụ mới thành một công cụ có thể hỗ trợ các ứng dụng như cuộc họp ảo hoặc trò chơi nâng cao.

Tập lệnh thứ hai đi sâu vào lập trình đổ bóng, đặc biệt giải quyết vấn đề biến dạng ống kính. Trình đổ bóng sửa các biến dạng trong nguồn cấp dữ liệu máy ảnh, sử dụng các thuộc tính như _DistortionStrength để thao tác cách ánh xạ tọa độ UV lên kết cấu. Điều này đặc biệt hữu ích khi xử lý các ống kính góc rộng hoặc máy ảnh có cấu hình biến dạng độc đáo. Ví dụ: nếu một đầu ảo trông lớn hơn hoặc nhỏ hơn khuôn mặt thực tế tùy thuộc vào góc độ, việc điều chỉnh cài đặt độ méo sẽ đảm bảo căn chỉnh tốt hơn. Nó giống như việc điều chỉnh khung gương để loại bỏ hiệu ứng nhà kính, làm cho hình ảnh phản chiếu trở nên chân thực hơn. 🎨

Cuối cùng, các bài kiểm tra đơn vị từ tập lệnh thứ ba sẽ xác thực các giải pháp. Các thử nghiệm này so sánh vị trí dự kiến và góc xoay của đầu ảo với kết quả thực tế, đảm bảo rằng các điều chỉnh được duy trì trong nhiều điều kiện khác nhau. Sử dụng NUnit Khẳng định.AreEqual, các nhà phát triển có thể mô phỏng các tình huống khác nhau, chẳng hạn như di chuyển đầu nhanh chóng hoặc nghiêng đầu ở các góc cực lớn để xác nhận sự căn chỉnh. Ví dụ, trong quá trình phát triển, tôi nhận thấy rằng việc căn chỉnh hoạt động tốt khi hướng về phía trước nhưng lại bị lệch khi đầu quay sang một bên. Các thử nghiệm đơn vị này đã nêu bật vấn đề và hướng dẫn các cải tiến tiếp theo, củng cố tầm quan trọng của việc thử nghiệm kỹ lưỡng trong việc tạo ra các ứng dụng AR mạnh mẽ. 🚀

Điều chỉnh vị trí đối tượng ảo trong AR bằng Unity và MediaPipe

Giải pháp 1: Sử dụng máy ảnh vật lý của Unity để điều chỉnh FOV và độ méo ống kính

// Import necessary Unity librariesusing UnityEngine;using Mediapipe.Unity;public class VirtualHeadAdjuster : MonoBehaviour{public Camera mainCamera; // Assign Unity's physical camerapublic GameObject virtualHead; // Assign the virtual head prefabprivate MediapipeFaceMesh faceMesh; // MediaPipe's face mesh componentvoid Start(){// Enable Unity's physical cameramainCamera.usePhysicalProperties = true;mainCamera.focalLength = 35f; // Set a standard focal length}void Update(){if (faceMesh != null && faceMesh.IsTracking){// Update the virtual head's position and rotationTransform detectedHead = faceMesh.GetDetectedFaceTransform();virtualHead.transform.position = detectedHead.position;virtualHead.transform.rotation = detectedHead.rotation;}}}

Khám phá các điều chỉnh thay thế cho việc căn chỉnh đầu ảo

Giải pháp 2: Sử dụng bộ đổ bóng tùy chỉnh để sửa hiện tượng méo ống kính

Shader "Custom/LensDistortionCorrection"{Properties{_DistortionStrength ("Distortion Strength", Float) = 0.5}SubShader{Pass{CGPROGRAM#pragma vertex vert#pragma fragment fragfloat _DistortionStrength;struct appdata{float4 vertex : POSITION;float2 uv : TEXCOORD0;};struct v2f{float4 pos : SV_POSITION;float2 uv : TEXCOORD0;};v2f vert (appdata v){v2f o;o.pos = UnityObjectToClipPos(v.vertex);o.uv = v.uv;return o;}fixed4 frag (v2f i) : SV_Target{float2 distUV = i.uv - 0.5;distUV *= 1.0 + _DistortionStrength * length(distUV);distUV += 0.5;return tex2D(_MainTex, distUV);}ENDCG}}}

Kiểm tra khả năng tương thích nâng cao trong các dự án AR của Unity

Giải pháp 3: Thực hiện các bài kiểm tra đơn vị cho việc căn chỉnh đầu ảo

using NUnit.Framework;using UnityEngine;using Mediapipe.Unity;[TestFixture]public class VirtualHeadAlignmentTests{private VirtualHeadAdjuster adjuster;private GameObject testHead;[SetUp]public void Init(){GameObject cameraObject = new GameObject("MainCamera");adjuster = cameraObject.AddComponent<VirtualHeadAdjuster>();testHead = new GameObject("VirtualHead");adjuster.virtualHead = testHead;}[Test]public void TestVirtualHeadAlignment(){Vector3 expectedPosition = new Vector3(0, 1, 2);Quaternion expectedRotation = Quaternion.Euler(0, 45, 0);adjuster.virtualHead.transform.position = expectedPosition;adjuster.virtualHead.transform.rotation = expectedRotation;Assert.AreEqual(expectedPosition, testHead.transform.position);Assert.AreEqual(expectedRotation, testHead.transform.rotation);}}

Tinh chỉnh vị trí AR thông qua các kỹ thuật hiệu chỉnh nâng cao

Một khía cạnh thường bị bỏ qua trong vấn đề căn chỉnh AR là tầm quan trọng của việc hiệu chỉnh máy ảnh. Trong các dự án AR như đặt đầu ảo lên đầu thật, ống kính thông số nội tại đóng một vai trò quan trọng. Các thông số này bao gồm độ dài tiêu cự, tâm quang và hệ số biến dạng. Khi những giá trị này không chính xác, đầu ảo có thể bị lệch hoặc bị biến dạng. Để giải quyết vấn đề này, có thể sử dụng các công cụ hiệu chỉnh để tính toán các thông số này cho camera của thiết bị cụ thể. Ví dụ: phần mềm như OpenCV cung cấp các tiện ích hiệu chỉnh mạnh mẽ để tạo ra các ma trận camera và cấu hình biến dạng chính xác. 📐

Một cách tiếp cận khác liên quan đến việc tận dụng Unity ngăn xếp hậu xử lý. Bằng cách áp dụng các hiệu ứng như độ sâu trường ảnh hoặc hiệu chỉnh quang sai màu, bạn có thể làm dịu đi sự khác biệt giữa đầu ảo được kết xuất và môi trường trong thế giới thực. Quá trình xử lý hậu kỳ bổ sung thêm một lớp đánh bóng giúp thu hẹp khoảng cách giữa các vật thể ảo và không gian vật lý. Ví dụ: hiệu ứng làm mờ tinh tế có thể làm giảm các cạnh khắc nghiệt khiến cho các điểm lệch đáng chú ý. Điều này đặc biệt hữu ích trong các ứng dụng nhập vai nơi người dùng tập trung cao độ vào khung cảnh.

Cuối cùng, đừng đánh giá thấp sức mạnh của việc thích ứng động trong thời gian chạy. Việc kết hợp các mô hình học máy vào quy trình AR của bạn có thể cho phép hệ thống tìm hiểu và điều chỉnh vị trí theo thời gian. Chẳng hạn, một mô hình AI có thể phân tích phản hồi của người dùng hoặc phát hiện sự không nhất quán và tinh chỉnh sự liên kết một cách linh hoạt. Điều này làm cho hệ thống mạnh mẽ hơn và có khả năng xử lý các biến thể về ánh sáng, hiệu suất thiết bị hoặc hành vi của người dùng. Những cải tiến này đảm bảo trải nghiệm AR liền mạch, giúp thế giới ảo và thực có cảm giác được tích hợp thực sự. 🚀

Các câu hỏi thường gặp về vị trí MediaPipe và Unity AR

- Tại sao đầu ảo của tôi bị lệch so với mặt thật?

- Vấn đề thường bắt nguồn từ việc hiệu chỉnh máy ảnh không đúng cách. Sử dụng các công cụ như OpenCV để tính toán camera matrix Và distortion coefficients có thể cải thiện đáng kể sự liên kết.

- Vai trò của tiêu cự trong căn chỉnh AR là gì?

- các focal length xác định cách máy ảnh chiếu các điểm 3D lên mặt phẳng 2D. Điều chỉnh nó trong cài đặt camera vật lý của Unity có thể nâng cao độ chính xác.

- Unity có thể xử lý việc chỉnh sửa méo ống kính không?

- Có, Unity hỗ trợ trình đổ bóng để sửa méo. Triển khai trình đổ bóng với các thuộc tính như _DistortionStrength để tùy chỉnh các chỉnh sửa dựa trên cấu hình ống kính của bạn.

- Làm cách nào để kiểm tra sự liên kết của các đối tượng ảo?

- Sử dụng các bài kiểm tra đơn vị trong NUnit với các lệnh như Assert.AreEqual cho phép bạn xác nhận vị trí và xoay của các đối tượng ảo trong các điều kiện khác nhau.

- Việc xử lý hậu kỳ có cần thiết cho các dự án AR không?

- Mặc dù không bắt buộc nhưng các hiệu ứng xử lý hậu kỳ như depth of field Và chromatic aberration có thể nâng cao chất lượng hình ảnh và tính chân thực của cảnh AR.

- MediaPipe có thể phát hiện các vật thể khác ngoài khuôn mặt không?

- Có, MediaPipe cung cấp các giải pháp về tay, tư thế và thậm chí theo dõi toàn diện, giúp giải pháp này trở nên linh hoạt cho các trường hợp sử dụng AR khác nhau.

- Phần cứng nào hoạt động tốt nhất cho các ứng dụng Unity AR?

- Các thiết bị có GPU hiệu suất cao và camera chính xác là lý tưởng. Công cụ như ARCore Và ARKit tăng cường hơn nữa khả năng tương thích.

- Tại sao việc căn chỉnh lại tệ hơn ở một số góc nhất định?

- Điều này có thể là do trường nhìn không khớp giữa máy ảnh và môi trường ảo. Điều chỉnh camera Unity fieldOfView tài sản có thể giúp đỡ.

- Trình đổ bóng cải thiện việc căn chỉnh AR như thế nào?

- Trình đổ bóng cho phép điều chỉnh kết xuất theo thời gian thực, chẳng hạn như sửa biến dạng hoặc mô phỏng hiệu ứng ống kính, đảm bảo đồng bộ hóa tốt hơn giữa các vật thể ảo và thực.

- Hệ thống AR có thể tự điều chỉnh theo thời gian không?

- Có, việc tích hợp các mô hình máy học cho phép hệ thống thích ứng linh hoạt, học hỏi từ phản hồi để cải thiện sự liên kết và hiệu suất theo thời gian.

Nâng cao độ chính xác của AR: Suy nghĩ cuối cùng

Đạt được sự liên kết chính xác giữa các đối tượng trong thế giới ảo và thế giới thực là rất quan trọng để có được trải nghiệm AR sống động. Thông qua hiệu chuẩn cẩn thận và các kỹ thuật tiên tiến, các vấn đề như méo ống kính và độ dài tiêu cự không khớp có thể được giảm thiểu, đảm bảo độ chính xác cao hơn và sự hài lòng của người dùng.

Việc tích hợp các công cụ của Unity, thuật toán MediaPipe và các điều chỉnh động mang đến các giải pháp mạnh mẽ cho các nhà phát triển AR. Những cải tiến này cho phép kết hợp liền mạch giữa thế giới vật lý và kỹ thuật số, mở ra những khả năng mới cho việc chơi game, cuộc họp ảo và hơn thế nữa. Với sự kiên trì và đổi mới, các thách thức liên kết AR sẽ trở nên dễ quản lý. 🚀

Nguồn và Tài liệu tham khảo

- Thông tin chi tiết về cách sử dụng MediaPipe trong Unity được tham khảo từ tài liệu MediaPipe chính thức. Khám phá nó đây .

- Bạn có thể tìm thấy hướng dẫn về hiệu chỉnh máy ảnh và các đặc tính vật lý của Unity trên trang tài liệu Unity. Thăm nom Cài đặt máy ảnh Unity để biết thêm chi tiết.

- Lập trình đổ bóng cho các ứng dụng AR và hiệu chỉnh méo ống kính được lấy cảm hứng từ các bài viết về phát triển trình đổ bóng, chẳng hạn như các bài viết trên Mã hóa giống mèo .

- Các khả năng và hạn chế của ARCore đối với việc phát triển Android đã được xem xét từ trang web dành cho nhà phát triển ARCore của Google. Tìm hiểu thêm tại Google ARCore .