Výzvy vo virtuálnom umiestnení hlavy pre rozvoj AR

Práca na projekte rozšírenej reality (AR) môže byť vzrušujúca aj náročná. Pri vývoji aplikácie pre Android s Unity som sa zameral na bezproblémové spojenie digitálneho a skutočného sveta umiestnením virtuálnej hlavy na tváre skutočného sveta. Táto funkcia sa vo veľkej miere spolieha na presnosť, aby vytvorila pohlcujúci zážitok. 🕶️

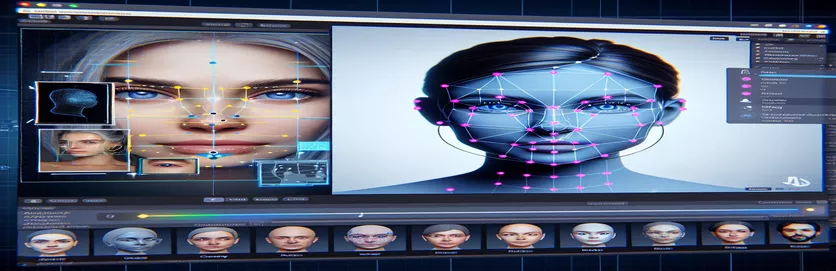

Aby som to dosiahol, použil som MediaPipe od Google na detekciu orientačných bodov tváre, ako sú oči, nosy a ústa. Virtuálna hlava bola potom vygenerovaná a umiestnená na základe týchto kľúčových bodov. Bolo fascinujúce vidieť, ako moderné nástroje dokážu transformovať možnosti AR, ale cesta nebola ani zďaleka dokonalá.

Problém sa objavil, keď sa virtuálna hlava nezrovnala so skutočnou tvárou, ako sa očakávalo. Bez ohľadu na uhol alebo zariadenie, umiestnenie bolo vždy trochu "mimo", čo viedlo k neprirodzenému efektu. Akoby bola virtuálna reprezentácia odpojená od reality. To vyvolalo sériu experimentov na riešenie problémov.

Od ladenia nastavení fotoaparátu Unity až po experimentovanie s algoritmom MediaPipe, každý pokus priniesol postupné vylepšenia, ale žiadne definitívne riešenie. Tento článok sa ponorí do jadra problému, získaných skúseností a potenciálnych riešení pre vývojárov, ktorí čelia podobným výzvam. 🚀

| Príkaz | Príklad použitia |

|---|---|

| mainCamera.usePhysicalProperties | Tento príkaz umožňuje použitie fyzických vlastností fotoaparátu Unity, čo umožňuje presnejšiu kontrolu nad ohniskovou vzdialenosťou a skreslením šošovky na zarovnanie virtuálnych a skutočných objektov. |

| faceMesh.GetDetectedFaceTransform() | Získava transformačné údaje (polohu a rotáciu) rozpoznanej tváre zo sieťky tvárí MediaPipe, čo je kľúčové pre presné umiestnenie virtuálnych hláv na skutočné tváre. |

| UnityObjectToClipPos | Funkcia špecifická pre shader, ktorá transformuje polohu vrcholu z priestoru objektu na priestor klipu, používaná v shaderoch korekcie skreslenia objektívu na zabezpečenie zarovnania. |

| tex2D | Príkaz shadera, ktorý sa používa na vzorkovanie textúry so špecifikovanými UV súradnicami, čo je nevyhnutné na aplikáciu korekcie skreslenia na posuvy kamery. |

| length(distUV) | Vypočíta euklidovskú vzdialenosť UV súradníc od počiatku, ktorá sa využíva na postupné úpravy skreslenia šošovky. |

| adjuster.virtualHead | Premenná skriptu odkazujúca na virtuálnu hlavu GameObject, ktorá umožňuje dynamickú aktualizáciu jej polohy a rotácie na základe údajov zo sledovania tváre. |

| [TestFixture] | Atribút NUnit, ktorý označuje triedu ako testovacie zariadenie, čo signalizuje, že obsahuje testy jednotiek. Je to užitočné na overenie logiky virtuálneho zarovnania hlavy. |

| Assert.AreEqual | Metóda NUnit používaná na porovnanie očakávaných a skutočných hodnôt počas testovania jednotky, čím sa zabezpečí, že umiestnenie virtuálnej hlavy zodpovedá požadovaným výsledkom. |

| _DistortionStrength | Vlastnosť shadera, ktorá upravuje intenzitu skreslenia šošovky a jemne dolaďuje zarovnanie medzi skutočným a virtuálnym svetom. |

| Quaternion.Euler | Vytvorí rotáciu na základe Eulerových uhlov, ktoré sa bežne používajú na zarovnanie objektov, ako je virtuálna hlava, v 3D priestore Unity. |

Vylepšenie presnosti AR pomocou Unity a MediaPipe

Prvý skript, ktorý sme preskúmali, sa zameriava na používanie fyzických vlastností fotoaparátu Unity. Povolením použite fyzikálne vlastnosti, upravujeme správanie fotoaparátu tak, aby lepšie zodpovedalo optike reálneho sveta. Toto je obzvlášť dôležité pri práci s AR, kde aj malé rozdiely v ohniskovej vzdialenosti alebo zornom poli môžu spôsobiť, že virtuálne objekty budú nesprávne zarovnané. Napríklad nastavenie ohniskovej vzdialenosti na presnú hodnotu, ako je 35 mm, môže pomôcť zarovnať virtuálnu hlavu s rozpoznanou tvárou. Táto úprava je podobná jemnému doladeniu teleskopu, aby sa vzdialené objekty dokonale zaostrili, čím sa zabezpečí, že zážitok z AR bude prirodzený a pohlcujúci. 📸

Ďalšou dôležitou súčasťou skriptu je získanie polohy a rotácie rozpoznanej tváre pomocou faceMesh.GetDetectedFaceTransform(). Táto funkcia poskytuje aktualizácie v reálnom čase z tvárovej siete MediaPipe, čo je nevyhnutné na synchronizáciu virtuálnej hlavy s pohybmi používateľa. Predstavte si, že hráte videohru, kde sa hlava vašej postavy nepohybuje synchronizovane s vašou; zážitok by bol nepríjemný. Zaistením presného zarovnania tento skript transformuje AR z novinky na nástroj, ktorý môže podporovať aplikácie, ako sú virtuálne stretnutia alebo pokročilé hry.

Druhý skript sa ponorí do programovania shaderov, konkrétne sa zaoberá skreslením šošovky. Shader koriguje skreslenia v podávaní fotoaparátu pomocou vlastností ako _DistortionStrength na manipuláciu s tým, ako sú UV súradnice mapované na textúru. To je obzvlášť užitočné pri práci so širokouhlými objektívmi alebo fotoaparátmi s jedinečnými profilmi skreslenia. Ak sa napríklad virtuálna hlava javí väčšia alebo menšia ako skutočná tvár v závislosti od uhla, vyladením nastavení skreslenia sa zabezpečí lepšie zarovnanie. Je to ako upraviť rám zrkadla, aby sa eliminoval efekt zábavného domu, vďaka čomu sú odrazy realistickejšie. 🎨

Nakoniec testy jednotiek z tretieho skriptu overia riešenia. Tieto testy porovnávajú očakávanú polohu a rotáciu virtuálnej hlavy so skutočnými výsledkami, čím sa zabezpečí, že nastavenia obstoja za rôznych podmienok. Pomocou NUnit's Assert.AreEqual, môžu vývojári simulovať rôzne scenáre, ako je rýchly pohyb hlavy alebo jej nakláňanie do extrémnych uhlov, aby potvrdili zarovnanie. Napríklad, počas vývoja som si všimol, že zarovnanie fungovalo dobre, keď smerovalo dopredu, ale unášalo sa, keď sa hlava otočila na stranu. Tieto testy jednotky poukázali na problém a usmernili ďalšie vylepšenia, čím sa posilnila dôležitosť dôkladného testovania pri vytváraní robustných aplikácií AR. 🚀

Úprava umiestnenia virtuálnych objektov v AR pomocou Unity a MediaPipe

Riešenie 1: Použitie fyzickej kamery Unity na úpravu FOV a skreslenia objektívu

// Import necessary Unity librariesusing UnityEngine;using Mediapipe.Unity;public class VirtualHeadAdjuster : MonoBehaviour{public Camera mainCamera; // Assign Unity's physical camerapublic GameObject virtualHead; // Assign the virtual head prefabprivate MediapipeFaceMesh faceMesh; // MediaPipe's face mesh componentvoid Start(){// Enable Unity's physical cameramainCamera.usePhysicalProperties = true;mainCamera.focalLength = 35f; // Set a standard focal length}void Update(){if (faceMesh != null && faceMesh.IsTracking){// Update the virtual head's position and rotationTransform detectedHead = faceMesh.GetDetectedFaceTransform();virtualHead.transform.position = detectedHead.position;virtualHead.transform.rotation = detectedHead.rotation;}}}

Preskúmanie alternatívnych úprav pre virtuálne zarovnanie hlavy

Riešenie 2: Použitie vlastného tienidla na korekciu skreslenia šošovky

Shader "Custom/LensDistortionCorrection"{Properties{_DistortionStrength ("Distortion Strength", Float) = 0.5}SubShader{Pass{CGPROGRAM#pragma vertex vert#pragma fragment fragfloat _DistortionStrength;struct appdata{float4 vertex : POSITION;float2 uv : TEXCOORD0;};struct v2f{float4 pos : SV_POSITION;float2 uv : TEXCOORD0;};v2f vert (appdata v){v2f o;o.pos = UnityObjectToClipPos(v.vertex);o.uv = v.uv;return o;}fixed4 frag (v2f i) : SV_Target{float2 distUV = i.uv - 0.5;distUV *= 1.0 + _DistortionStrength * length(distUV);distUV += 0.5;return tex2D(_MainTex, distUV);}ENDCG}}}

Testovanie vylepšenej kompatibility v projektoch AR spoločnosti Unity

Riešenie 3: Implementácia testov jednotiek na zarovnanie virtuálnej hlavy

using NUnit.Framework;using UnityEngine;using Mediapipe.Unity;[TestFixture]public class VirtualHeadAlignmentTests{private VirtualHeadAdjuster adjuster;private GameObject testHead;[SetUp]public void Init(){GameObject cameraObject = new GameObject("MainCamera");adjuster = cameraObject.AddComponent<VirtualHeadAdjuster>();testHead = new GameObject("VirtualHead");adjuster.virtualHead = testHead;}[Test]public void TestVirtualHeadAlignment(){Vector3 expectedPosition = new Vector3(0, 1, 2);Quaternion expectedRotation = Quaternion.Euler(0, 45, 0);adjuster.virtualHead.transform.position = expectedPosition;adjuster.virtualHead.transform.rotation = expectedRotation;Assert.AreEqual(expectedPosition, testHead.transform.position);Assert.AreEqual(expectedRotation, testHead.transform.rotation);}}

Zdokonalenie umiestnenia AR pomocou vylepšených techník kalibrácie

Jedným z často prehliadaných aspektov problémov so zarovnaním AR je dôležitosť kalibrácie kamery. V projektoch AR, ako je umiestnenie virtuálnej hlavy nad skutočnú hlavu objektívu vnútorné parametre hrať dôležitú úlohu. Tieto parametre zahŕňajú ohniskovú vzdialenosť, optický stred a koeficienty skreslenia. Ak tieto hodnoty nie sú presné, virtuálna hlava sa môže zdať nesprávne zarovnaná alebo zdeformovaná. Na vyriešenie tohto problému je možné použiť kalibračné nástroje na výpočet týchto parametrov pre konkrétnu kameru zariadenia. Napríklad softvér ako OpenCV ponúka robustné kalibračné nástroje na generovanie presných matríc kamier a profilov skreslenia. 📐

Ďalší prístup zahŕňa využitie Unity's zásobník následného spracovania. Použitím efektov, ako je hĺbka ostrosti alebo korekcie chromatickej aberácie, môžete vyrovnať nezrovnalosti medzi vykreslenou virtuálnou hlavou a skutočným prostredím. Následné spracovanie pridáva vrstvu lesku, ktorá premosťuje priepasť medzi virtuálnymi objektmi a fyzickými priestormi. Napríklad efekt jemného rozmazania môže znížiť ostré okraje, ktoré spôsobujú, že sú nezarovnané. To je užitočné najmä v pohlcujúcich aplikáciách, kde sa používatelia veľmi sústredia na scénu.

Nakoniec nepodceňujte silu dynamickej adaptácie počas behu. Začlenenie modelov strojového učenia do vášho kanála AR môže systému umožniť učiť sa a upravovať umiestnenie v priebehu času. Napríklad model AI by mohol analyzovať spätnú väzbu od používateľov alebo zistiť nezrovnalosti a dynamicky doladiť zarovnanie. Vďaka tomu je systém robustnejší a dokáže sa vysporiadať s variáciami osvetlenia, výkonu zariadenia alebo správania používateľov. Tieto vylepšenia zaisťujú bezproblémový zážitok z AR, vďaka čomu sa virtuálny a skutočný svet cíti skutočne integrovaný. 🚀

Bežné otázky týkajúce sa umiestnenia MediaPipe a Unity AR

- Prečo je moja virtuálna hlava nesprávne zarovnaná so skutočnou tvárou?

- Problém často pramení z nesprávnej kalibrácie fotoaparátu. Použitie nástrojov ako OpenCV na výpočet camera matrix a distortion coefficients môže výrazne zlepšiť zarovnanie.

- Aká je úloha ohniskovej vzdialenosti pri zarovnaní AR?

- The focal length definuje, ako kamera premieta 3D body do 2D roviny. Úpravou vo fyzických nastaveniach fotoaparátu Unity môžete zvýšiť presnosť.

- Dokáže Unity zvládnuť korekciu skreslenia objektívu?

- Áno, Unity podporuje shadery na korekciu skreslenia. Implementujte shader s vlastnosťami ako _DistortionStrength na prispôsobenie korekcií na základe vášho profilu objektívu.

- Ako môžem otestovať zarovnanie virtuálnych objektov?

- Použitie testov jednotiek v NUnit s príkazmi ako Assert.AreEqual umožňuje overiť umiestnenie a rotáciu virtuálnych objektov za rôznych podmienok.

- Je pre projekty AR potrebné následné spracovanie?

- Aj keď to nie je povinné, efekty následného spracovania sú ako depth of field a chromatic aberration môže zlepšiť vizuálnu kvalitu a realizmus AR scén.

- Dokáže MediaPipe rozpoznať iné objekty ako tváre?

- Áno, MediaPipe ponúka riešenia pre ruky, pózu a dokonca aj holistické sledovanie, vďaka čomu je všestranný pre rôzne prípady použitia AR.

- Aký hardvér funguje najlepšie pre aplikácie Unity AR?

- Ideálne sú zariadenia s vysokovýkonnými GPU a presnými kamerami. Nástroje ako ARCore a ARKit ďalej zvýšiť kompatibilitu.

- Prečo je zarovnanie v určitých uhloch horšie?

- Môže to byť spôsobené nesúladom zorného poľa medzi kamerou a virtuálnym prostredím. Nastavenie kamery Unity fieldOfView majetok môže pomôcť.

- Ako shadery zlepšujú zarovnanie AR?

- Shadery umožňujú úpravy vykresľovania v reálnom čase, ako je korekcia skreslení alebo simulácia efektov šošoviek, čím sa zabezpečuje lepšia synchronizácia medzi virtuálnymi a skutočnými objektmi.

- Môžu sa systémy AR samočinne prispôsobovať v priebehu času?

- Áno, integrácia modelov strojového učenia umožňuje systémom dynamicky sa prispôsobovať, učiť sa zo spätnej väzby, aby sa časom zlepšilo zosúladenie a výkon.

Zlepšenie presnosti AR: Záverečné myšlienky

Dosiahnutie presného zarovnania medzi virtuálnymi a skutočnými objektmi je kľúčové pre pohlcujúce zážitky v AR. Prostredníctvom starostlivej kalibrácie a pokročilých techník je možné zmierniť problémy, ako je skreslenie objektívu a nesúlad ohniskových vzdialeností, čím sa zabezpečí lepšia presnosť a spokojnosť používateľa.

Integrácia nástrojov Unity, algoritmov MediaPipe a dynamických úprav ponúka robustné riešenia pre vývojárov AR. Tieto vylepšenia umožňujú bezproblémové spojenie digitálneho a fyzického sveta a odomykajú nové možnosti pre hranie hier, virtuálne stretnutia a ďalšie. S vytrvalosťou a inováciami sa výzvy zosúladenia AR stanú zvládnuteľnými. 🚀

Zdroje a odkazy

- Podrobnosti o používaní MediaPipe v Unity boli uvedené v oficiálnej dokumentácii MediaPipe. Preskúmajte to tu .

- Návod na kalibráciu a fyzikálne vlastnosti fotoaparátu Unity možno nájsť na stránke dokumentácie Unity. Navštívte Nastavenia fotoaparátu Unity pre viac podrobností.

- Programovanie shaderov pre aplikácie AR a korekcia skreslenia šošoviek bolo inšpirované článkami o vývoji shaderov, ako sú napr Catlike Coding .

- Možnosti a obmedzenia ARCore pre vývoj Androidu boli preskúmané z vývojárskej stránky ARCore spoločnosti Google. Viac sa dozviete na Google ARCore .