Väljakutsed virtuaalse pea paigutamisel AR arendamiseks

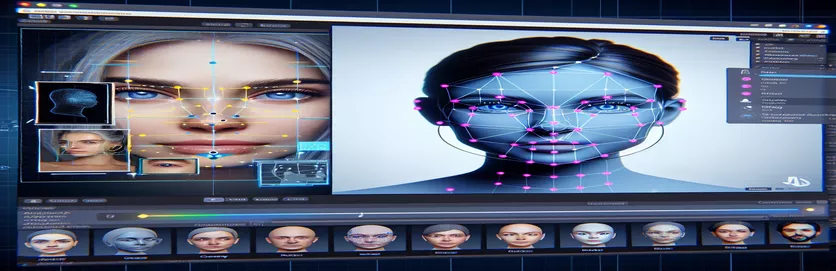

Liitreaalsuse (AR) projektiga töötamine võib olla nii põnev kui ka väljakutseid pakkuv. Unityga Androidi rakendust arendades püüdsin digitaalset ja reaalset maailma sujuvalt segada, asetades virtuaalse pea reaalsete nägude kohale. See funktsioon sõltub kaasahaarava kogemuse loomiseks suuresti täpsusest. 🕶️

Selle saavutamiseks kasutasin Google'i MediaPipe'i, et tuvastada näo maamärgid, nagu silmad, ninad ja suu. Seejärel genereeriti ja paigutati nende põhipunktide põhjal virtuaalne pea. Oli põnev näha, kuidas kaasaegsed tööriistad võivad AR-võimalusi muuta, kuid teekond polnud kaugeltki täiuslik.

Probleem ilmnes siis, kui virtuaalne pea ei ühtinud ootuspäraselt tegeliku näoga. Olenemata nurgast või seadmest, oli paigutus alati veidi "väljas", mis tõi kaasa ebaloomuliku efekti. Tundus, nagu oleks virtuaalne esitus reaalsusest lahti ühendatud. See käivitas rea tõrkeotsingu katseid.

Alates Unity kaameraseadete muutmisest kuni MediaPipe'i algoritmiga katsetamiseni tõi iga katse kaasa järkjärgulisi täiustusi, kuid lõplikku lahendust ei leitud. Selles artiklis käsitletakse probleemi tuuma, saadud õppetunde ja võimalikke lahendusi arendajatele, kes seisavad silmitsi sarnaste väljakutsetega. 🚀

| Käsk | Kasutusnäide |

|---|---|

| mainCamera.usePhysicalProperties | See käsk võimaldab kasutada Unity füüsilisi kaamera omadusi, võimaldades täpsemalt juhtida fookuskaugust ja objektiivi moonutusi, et joondada virtuaalseid ja reaalseid objekte. |

| faceMesh.GetDetectedFaceTransform() | Otsib MediaPipe'i näovõrgust tuvastatud näo teisendusandmed (asend ja pöörlemine), mis on ülioluline virtuaalsete peade täpseks paigutamiseks reaalsete nägude kohale. |

| UnityObjectToClipPos | Varjutuspetsiifiline funktsioon, mis muudab tipu asukoha objektiruumist klipiruumiks, mida kasutatakse joondamise tagamiseks objektiivi moonutusi korrigeerivates varjundites. |

| tex2D | Varjutuskäsk, mida kasutatakse tekstuuri proovide võtmiseks kindlaksmääratud UV-koordinaatidel, mis on kaameravoogudele moonutuste korrigeerimise rakendamiseks hädavajalik. |

| length(distUV) | Arvutab UV-koordinaatide eukleidilise kauguse lähtepunktist, mida kasutatakse objektiivi moonutuste järkjärguliseks reguleerimiseks. |

| adjuster.virtualHead | Skriptimuutuja, mis viitab virtuaalsele peale GameObject, mis võimaldab selle asukohta ja pöörlemist näojälgimise andmete põhjal dünaamiliselt värskendada. |

| [TestFixture] | NUnit atribuut, mis märgib klassi testseadmena, andes märku, et see sisaldab ühikuteste. See on kasulik virtuaalse pea joondamise loogika kontrollimiseks. |

| Assert.AreEqual | NUnit meetod, mida kasutatakse eeldatavate ja tegelike väärtuste võrdlemiseks üksuse testimise ajal, tagades, et virtuaalse pea paigutus vastab soovitud tulemustele. |

| _DistortionStrength | Varjutaja omadus, mis reguleerib objektiivi moonutuste intensiivsust, täpsustades reaalse ja virtuaalse maailma joondamist. |

| Quaternion.Euler | Loob Euleri nurkade põhjal pöörde, mida tavaliselt kasutatakse Unity 3D-ruumis objektide, näiteks virtuaalse pea joondamiseks. |

AR-i täpsuse parandamine Unity ja MediaPipe'iga

Esimene skript, mida uurisime, keskendub Unity füüsilise kaamera omaduste kasutamisele. Lubades kasutage PhysicalProperties, kohandame kaamera käitumist nii, et see vastaks täpsemalt reaalse maailma optikale. See on eriti oluline AR-ga töötamisel, kus isegi väikesed fookuskauguse või vaatevälja erinevused võivad muuta virtuaalsed objektid valesti joondatud. Näiteks fookuskauguse täpse väärtuse (nt 35 mm) määramine võib aidata virtuaalse pea tuvastatud näoga joondada. See reguleerimine sarnaneb teleskoobi peenhäälestusega, et tuua kaugel olevad objektid täiuslikult fookusesse, tagades, et AR-kogemus tundub loomulik ja kaasahaarav. 📸

Skripti teine oluline komponent on tuvastatud näo asukoha ja pööramise otsimine faceMesh.GetDetectedFaceTransform(). See funktsioon pakub MediaPipe'i näovõrgust reaalajas värskendusi, mis on hädavajalikud virtuaalse pea sünkroonimiseks kasutaja liigutustega. Kujutage ette, et mängite videomängu, kus teie tegelase pea ei liigu sünkroonis teie omaga; kogemus oleks jahmatav. Tagades täpse joonduse, muudab see skript AR-i uudsest tööriistaks, mis toetab selliseid rakendusi nagu virtuaalsed koosolekud või täiustatud mängimine.

Teine skript süveneb varjude programmeerimisse, käsitledes konkreetselt objektiivi moonutusi. Varjutaja parandab kaamera voo moonutusi, kasutades selliseid omadusi nagu _DistortionStrength, et manipuleerida UV-koordinaatide tekstuurile vastendamisega. See on eriti kasulik lainurkobjektiivide või ainulaadsete moonutusprofiilidega kaamerate puhul. Näiteks kui virtuaalne pea näib olenevalt nurgast suurem või väiksem tegelikust näost, tagab moonutuste seadistuste muutmine parema joonduse. See on nagu peegli raami reguleerimine, et kõrvaldada lõbustusmaja efekt, muutes peegeldused realistlikumaks. 🎨

Lõpuks kinnitavad lahendusi kolmanda skripti ühikutestid. Need testid võrdlevad virtuaalse pea eeldatavat asendit ja pöörlemist tegelike tulemustega, tagades, et reguleerimised püsivad erinevates tingimustes. NUniti kasutamine Assert.AreEqual, saavad arendajad joonduse kinnitamiseks simuleerida erinevaid stsenaariume, nagu pea kiiret liigutamist või äärmuslike nurkade all kallutamist. Näiteks märkasin arenduse käigus, et joondumine toimis hästi ettepoole suunatud näoga, kuid triivib pea küljele pööramisel. Need üksusetestid tõid probleemi esile ja suunasid edasisi täiustusi, suurendades põhjaliku testimise tähtsust tugevate AR-rakenduste loomisel. 🚀

Virtuaalsete objektide paigutuse reguleerimine AR-is Unity ja MediaPipe'i abil

Lahendus 1: Unity'i füüsilise kaamera kasutamine FOV ja objektiivi moonutuste reguleerimiseks

// Import necessary Unity librariesusing UnityEngine;using Mediapipe.Unity;public class VirtualHeadAdjuster : MonoBehaviour{public Camera mainCamera; // Assign Unity's physical camerapublic GameObject virtualHead; // Assign the virtual head prefabprivate MediapipeFaceMesh faceMesh; // MediaPipe's face mesh componentvoid Start(){// Enable Unity's physical cameramainCamera.usePhysicalProperties = true;mainCamera.focalLength = 35f; // Set a standard focal length}void Update(){if (faceMesh != null && faceMesh.IsTracking){// Update the virtual head's position and rotationTransform detectedHead = faceMesh.GetDetectedFaceTransform();virtualHead.transform.position = detectedHead.position;virtualHead.transform.rotation = detectedHead.rotation;}}}

Alternatiivsete kohanduste uurimine pea virtuaalseks joondamiseks

Lahendus 2: kohandatud varjundi kasutamine objektiivi moonutuste parandamiseks

Shader "Custom/LensDistortionCorrection"{Properties{_DistortionStrength ("Distortion Strength", Float) = 0.5}SubShader{Pass{CGPROGRAM#pragma vertex vert#pragma fragment fragfloat _DistortionStrength;struct appdata{float4 vertex : POSITION;float2 uv : TEXCOORD0;};struct v2f{float4 pos : SV_POSITION;float2 uv : TEXCOORD0;};v2f vert (appdata v){v2f o;o.pos = UnityObjectToClipPos(v.vertex);o.uv = v.uv;return o;}fixed4 frag (v2f i) : SV_Target{float2 distUV = i.uv - 0.5;distUV *= 1.0 + _DistortionStrength * length(distUV);distUV += 0.5;return tex2D(_MainTex, distUV);}ENDCG}}}

Unity AR-projektide täiustatud ühilduvuse testimine

Lahendus 3: üksusetestide rakendamine virtuaalse pea joondamiseks

using NUnit.Framework;using UnityEngine;using Mediapipe.Unity;[TestFixture]public class VirtualHeadAlignmentTests{private VirtualHeadAdjuster adjuster;private GameObject testHead;[SetUp]public void Init(){GameObject cameraObject = new GameObject("MainCamera");adjuster = cameraObject.AddComponent<VirtualHeadAdjuster>();testHead = new GameObject("VirtualHead");adjuster.virtualHead = testHead;}[Test]public void TestVirtualHeadAlignment(){Vector3 expectedPosition = new Vector3(0, 1, 2);Quaternion expectedRotation = Quaternion.Euler(0, 45, 0);adjuster.virtualHead.transform.position = expectedPosition;adjuster.virtualHead.transform.rotation = expectedRotation;Assert.AreEqual(expectedPosition, testHead.transform.position);Assert.AreEqual(expectedRotation, testHead.transform.rotation);}}

AR paigutuse täpsustamine täiustatud kalibreerimistehnikate abil

Üks AR-i joondamise probleemide sageli tähelepanuta jäetud aspekt on kaamera kalibreerimise tähtsus. AR-projektides, nagu virtuaalse pea asetamine päris pea, objektiivi kohale sisemised parameetrid mängivad olulist rolli. Need parameetrid hõlmavad fookuskaugust, optilist keskpunkti ja moonutuskoefitsiente. Kui need väärtused pole täpsed, võib virtuaalne pea näida valesti joondatud või moonutatud. Selle lahendamiseks saab nende parameetrite arvutamiseks konkreetse seadme kaamera jaoks kasutada kalibreerimistööriistu. Näiteks tarkvara nagu OpenCV pakub usaldusväärseid kalibreerimisutiliite täpsete kaameramaatriksite ja moonutusprofiilide loomiseks. 📐

Teine lähenemisviis hõlmab Unity'i võimendamist järeltöötluse virn. Rakendades selliseid efekte nagu teravussügavus või kromaatilise aberratsiooni parandused, saate siluda lahknevusi renderdatud virtuaalse pea ja reaalse keskkonna vahel. Järeltöötlus lisab lihvikihi, mis sillutab lõhe virtuaalsete objektide ja füüsiliste ruumide vahel. Näiteks võib peen hägususe efekt vähendada karme servi, mis muudavad joondusvead märgatavaks. See on eriti kasulik ümbritsevate rakenduste puhul, kus kasutajad on stseenile väga keskendunud.

Lõpuks ärge alahinnake dünaamilise kohanemise jõudu käitusajal. Masinõppemudelite lisamine oma AR-torusse võib võimaldada süsteemil õppida ja aja jooksul paigutust kohandada. Näiteks võib AI-mudel analüüsida kasutajate tagasisidet või tuvastatud ebakõlasid ja joondamist dünaamiliselt täpsustada. See muudab süsteemi vastupidavamaks ja suudab tulla toime valgustuse, seadme jõudluse või kasutaja käitumise erinevustega. Need täiustused tagavad sujuva AR-kogemuse, muutes virtuaalse ja reaalse maailma tõeliselt integreerituks. 🚀

Levinud küsimused MediaPipe'i ja Unity AR paigutuse kohta

- Miks on minu virtuaalne pea tegeliku näoga valesti joondatud?

- Probleem tuleneb sageli kaamera valest kalibreerimisest. Kasutage arvutamiseks selliseid tööriistu nagu OpenCV camera matrix ja distortion coefficients võib joondamist oluliselt parandada.

- Milline on fookuskauguse roll AR-i joondamisel?

- The focal length määrab, kuidas kaamera projitseerib 3D-punkte 2D-tasandile. Selle reguleerimine Unity füüsilise kaamera seadetes võib suurendada täpsust.

- Kas Unity saab hakkama objektiivi moonutuste korrigeerimisega?

- Jah, Unity toetab varjutajaid moonutuste korrigeerimiseks. Rakendage varjutaja selliste omadustega nagu _DistortionStrength paranduste kohandamiseks teie objektiivi profiili põhjal.

- Kuidas saab testida virtuaalsete objektide joondamist?

- Ühikutestide kasutamine NUnitis selliste käskudega nagu Assert.AreEqual võimaldab valideerida virtuaalsete objektide positsioneerimist ja pööramist erinevates tingimustes.

- Kas AR-projektide puhul on vajalik järeltöötlus?

- Kuigi see pole kohustuslik, on järeltöötlusefektid nagu depth of field ja chromatic aberration võib parandada AR-stseenide visuaalset kvaliteeti ja realistlikkust.

- Kas MediaPipe suudab tuvastada muid objekte peale nägude?

- Jah, MediaPipe pakub lahendusi käte, pooside ja isegi tervikliku jälgimise jaoks, muutes selle mitmekülgseks erinevateks AR-i kasutusjuhtudeks.

- Milline riistvara töötab Unity AR-i rakenduste jaoks kõige paremini?

- Suure jõudlusega GPU-de ja täpsete kaameratega seadmed on ideaalsed. Tööriistad nagu ARCore ja ARKit parandada ühilduvust veelgi.

- Miks on joondus teatud nurkade puhul halvem?

- See võib olla tingitud kaamera ja virtuaalse keskkonna vaatevälja mittevastavusest. Unity kaamera reguleerimine fieldOfView vara võib aidata.

- Kuidas varjutajad AR-i joondamist parandavad?

- Varjud võimaldavad renderdamist reaalajas reguleerida, näiteks korrigeerida moonutusi või simuleerida objektiiviefekte, tagades parema sünkroonimise virtuaalsete ja reaalsete objektide vahel.

- Kas AR-süsteemid saavad aja jooksul ise reguleerida?

- Jah, masinõppemudelite integreerimine võimaldab süsteemidel dünaamiliselt kohaneda, õppides tagasisidest, et parandada aja jooksul joondamist ja jõudlust.

AR-i täpsuse parandamine: viimased mõtted

Täpne joondamine virtuaalsete ja reaalmaailma objektide vahel on kaasahaarava AR-kogemuse jaoks ülioluline. Hoolika kalibreerimise ja täiustatud tehnikate abil saab selliseid probleeme nagu objektiivi moonutused ja fookuskauguste mittevastavus leevendada, tagades parema täpsuse ja kasutajate rahulolu.

Unity tööriistade, MediaPipe'i algoritmide ja dünaamiliste kohanduste integreerimine pakub AR-arendajatele tugevaid lahendusi. Need täiustused võimaldavad sujuvalt kombineerida digitaalset ja füüsilist maailma, avades uusi võimalusi mängimiseks, virtuaalseteks koosolekuteks ja mujal. Püsivuse ja uuenduslikkusega muutuvad AR-i joondamise väljakutsed juhitavaks. 🚀

Allikad ja viited

- Üksikasjad MediaPipe'i kasutamise kohta Unity'is viidati ametlikust MediaPipe'i dokumentatsioonist. Uurige seda siin .

- Juhised Unity kaamera kalibreerimise ja füüsikaliste omaduste kohta leiate Unity dokumentatsiooni saidilt. Külastage Unity kaamera seaded lisateabe saamiseks.

- Varjundite programmeerimine AR-rakenduste ja objektiivi moonutuste korrigeerimise jaoks on inspireeritud varjundite arendamist käsitlevatest artiklitest, näiteks artiklitest Kassilaadne kodeerimine .

- ARCore'i võimalused ja Androidi arenduse piirangud vaadati üle Google'i ARCore'i arendaja saidilt. Lisateavet leiate aadressilt Google ARCore .